در دنیای پرشتاب امروز، وسوسه استفاده از ابزارهای هوش مصنوعی برای افزایش سرعت و کارایی در حرفه وکالت، روزبهروز بیشتر میشود. توانایی این ابزارها در تهیه پیشنویس یک لایحه در چند دقیقه یا تحلیل یک قرارداد قطور در زمانی کوتاه، انکارناپذیر است. اما این بهرهوری شگفتانگیز، یک پرسش بنیادین و حیاتی را برای ما به عنوان وکیل مطرح میکند: آیا میتوانیم به ابزارهای هوشمند تکیه کنیم بدون آنکه وظایف بنیادین حرفهای و اخلاقی خود را نقض نماییم؟ مرز باریک میان استفاده هوشمندانه از یک ابزار کارآمد و ارتکاب یک تخلف انتظامی کجاست؟ این مقاله به بررسی همین مرزها، خطرات نادیدهگرفتهشده و الزامات اخلاقی میپردازد که هر وکیل مدرنی باید با آنها آشنا باشد.

پیش از ورود به چالشها، باید مزایای واقعی را به رسمیت شناخت. ابزارهای هوش مصنوعی عمومی که امروزه در ایران قابل دسترسی هستند، مانند ChatGPT و Gemini، یا سامانههای هوشمند جستجوی قوانین و آرا، میتوانند به عنوان یک دستیار حقوقی خستگیناپذیر عمل کنند. مزایای اصلی آنها عبارتند از:

صرفهجویی در زمان: خودکارسازی وظایف تکراری مانند تهیه پیشنویسهای استاندارد یا خلاصهسازی متون، زمان وکیل را برای تمرکز بر تحلیل استراتژیک آزاد میکند.

افزایش دقت در نوشتار: این ابزارها میتوانند به بهبود ساختار جملات، یافتن غلطهای املایی و نگارشی و یکدستسازی متون حقوقی کمک کنند.

کاهش هزینهها: با افزایش سرعت، هزینههای مربوط به هر پرونده کاهش یافته و دسترسی به خدمات حقوقی میتواند برای بخش بزرگتری از جامعه ممکن شود. این مزایا، استفاده از هوش مصنوعی را به یک انتخاب هوشمندانه برای افزایش بهرهوری تبدیل میکند، اما این تمام داستان نیست.

اخلاق حرفهای، ستون فقرات حرفه وکالت است. اصول بنیادینی که در سوگندنامه و آییننامههای وکالت بر آنها تأکید شده، در مواجهه با هوش مصنوعی باید با دقت بیشتری بازخوانی شوند. در اینجا به سه اصل کلیدی و خطرات نقض آنها اشاره میکنیم:

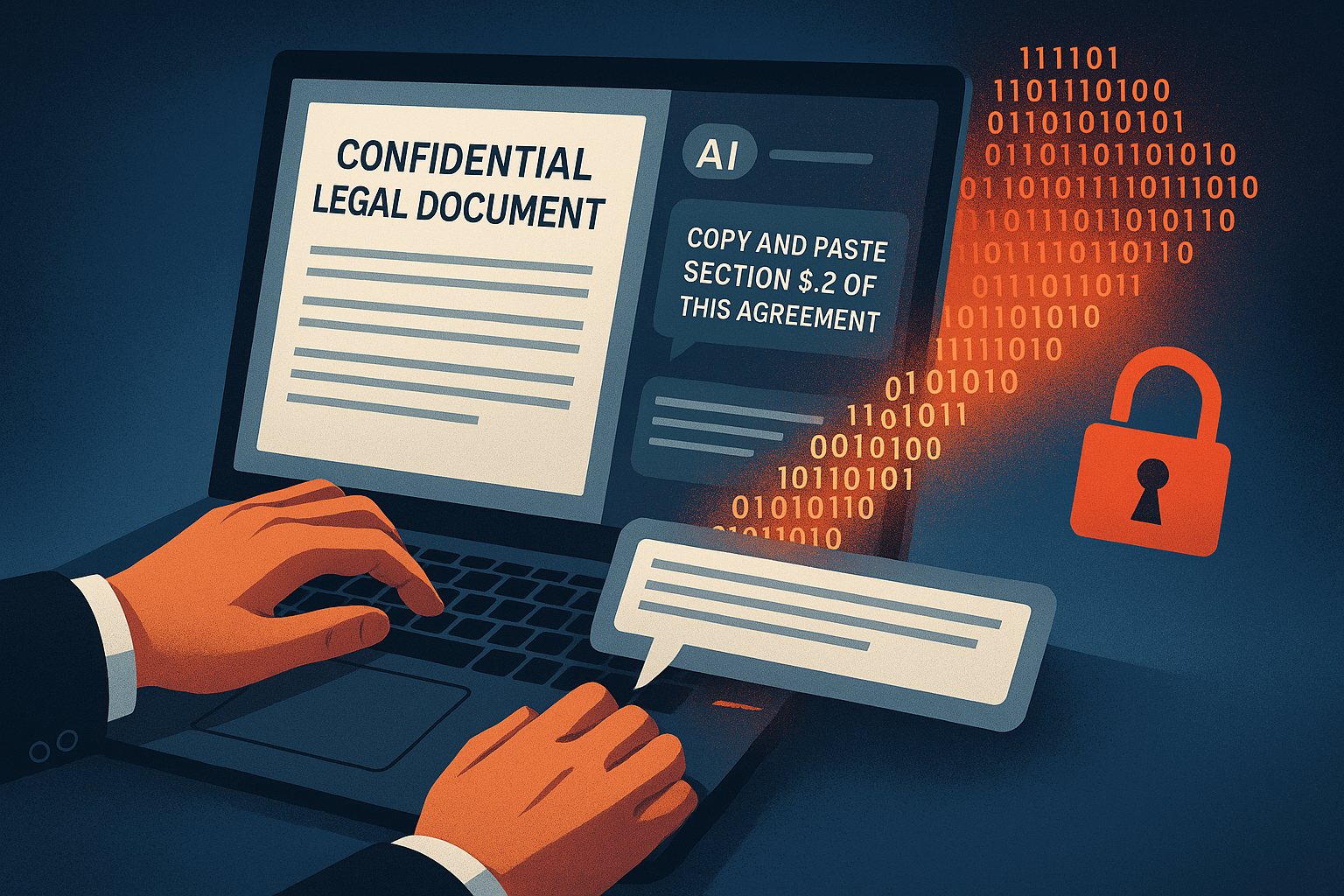

اصل رازداری و حفظ اسرار موکل: این مهمترین و آسیبپذیرترین اصل است. وارد کردن هرگونه اطلاعات محرمانه از یک پرونده—از نام موکل گرفته تا جزئیات یک اختلاف—در نسخههای عمومی پلتفرمهای هوش مصنوعی، یک تخلف انتظامی آشکار و نقض صریح وظیفه حفظ اسرار حرفهای است. این پلتفرمها ممکن است از دادههای شما برای آموزش مدلهای آینده خود استفاده کنند و هیچ تضمینی برای محرمانگی اطلاعات وجود ندارد.

اصل مسئولیتپذیری و نظارت شخصی: وکیلی که یک لایحه، قرارداد یا دادخواست را امضا میکند، مسئولیت کامل و نهایی تمام محتوای آن را بر عهده دارد. تکیه کورکورانه به خروجی یک ابزار هوشمند و عدم بررسی دقیق و کلمه به کلمه آن، مصداق بارز قصور و بیاحتیاطی حرفهای است. اگر هوش مصنوعی یک ماده قانونی منسوخ را ذکر کند یا تفسیری اشتباه ارائه دهد، این «وکیل» است که باید پاسخگو باشد، نه «الگوریتم».

اصل صداقت و ارائه مشاوره صحیح: ارائه مشاوره حقوقی صرفاً بر مبنای خروجی یک مدل زبانی، بدون آنکه آن را با دانش حقوقی، تجربه و شمّ وکالتی خود تطبیق دهید، نقض وظیفه صداقت در برابر موکل است. موکل به شما به عنوان یک متخصص اعتماد کرده است، نه به یک اپراتور نرمافزار.

در جامعه حقوقی، دو دیدگاه متفاوت در مورد تأثیر بلندمدت هوش مصنوعی بر اخلاق حرفهای در حال شکلگیری است:

دیدگاه اول (تهدیدمحور): این دیدگاه معتقد است که اتکای بیش از حد به هوش مصنوعی میتواند به «تنبلی فکری» و تحلیل رفتن مهارتهای بنیادین وکلا منجر شود. وقتی یک ماشین میتواند به سرعت پیشنویس تهیه کند، انگیزه برای تفکر عمیق حقوقی و استدلالپردازی خلاقانه کاهش مییابد. این امر میتواند استقلال علمی و فکری وکیل را، که از ارکان حرفه است، تضعیف کند.

دیدگاه دوم (فرصتمحور): این دیدگاه بر این باور است که اگر از هوش مصنوعی به صورت آگاهانه استفاده شود، میتواند اخلاق حرفهای را تقویت کند. برای مثال، یک ابزار تحلیل قرارداد میتواند بندی مبهم یا غیرمنصفانه را که ممکن است از چشم وکیل خسته دور بماند، شناسایی کند و به شفافیت بیشتر قرارداد کمک نماید. یا یک ابزار تحقیق هوشمند، با یافتن رویههای قضایی مرتبط، از ارائه یک استدلال ضعیف و نادرست جلوگیری کرده و دقت علمی کار وکیل را افزایش دهد.

برای جلوگیری از هرجومرج و تضمین استفاده مسئولانه از این فناوری، نهادهای سیاستگذار و صنفی، به ویژه کانونهای وکلا، باید نقشی فعال ایفا کنند:

تدوین رهنمودهای اخلاقی: ضروری است که کانونهای وکلا، یک راهنمای اخلاقی مشخص و کاربردی در زمینه بایدها و نبایدهای استفاده از هوش مصنوعی در وکالت تدوین و منتشر کنند.

ایجاد الزامات شفافسازی: باید بررسی شود که آیا وکیل موظف است استفاده از ابزارهای هوشمند در تهیه اسناد یا ارائه مشاوره را به موکل خود اطلاع دهد یا خیر. این شفافیت میتواند به حفظ اعتماد میان وکیل و موکل کمک کند.

طراحی یک کد اخلاقی مکمل: میتوان یک ضمیمه یا کد اخلاقی ویژه فناوری به آییننامههای موجود اضافه کرد که به طور مشخص به چالشهای جدیدی مانند حریم خصوصی دادهها، مسئولیت الگوریتمی و نظارت انسانی بپردازد.

هوش مصنوعی در وکالت، نه یک تهدید ذاتی و نه یک راهحل جادویی، بلکه یک چاقوی دولبه و قدرتمند است. نحوه استفاده از این ابزار و آگاهی عمیق وکیل از مسئولیتهای اخلاقی و حرفهای خویش، تعیینکننده نتیجه نهایی است. بدون داشتن یک چارچوب اخلاقی و نظارتی مشخص، مرز میان بهرهوری و تخلف بسیار باریک خواهد بود و کارایی میتواند به سادگی به قیمت قربانی کردن اصول بنیادین حرفه ما تمام شود. وکیل آینده، متخصصی است که میداند چگونه از این ابزارها برای تقویت تخصص خود استفاده کند، نه آنکه تخصص خود را به آنها برونسپاری نماید.