اگر اخیراً شاهد افت یا نوسان شدید در ترافیک سایتتان بودهاید و این سوال ذهنتان را مشغول کرده که «کدام الگوریتم گوگل دوباره تغییر کرده و سایت من را جریمه کرده است؟»، بگذارید مستقیماً پاسخ دهم: الگوریتمها نه دشمن شما هستند و نه دوست؛ آنها قانونگذارانی هستند که با هر تغییر، استانداردهای E-E-A-T (تخصص، تجربه، اعتبار و اعتماد) را سختتر میکنند تا فقط شایستهترینها در صدر باشند. هدف نهایی آنها، صرفاً خدمت به کاربر است. درک این حقیقت، اولین گام برای توقف فکرهای وسواسی درباره جریمههای گوگل و شروع تفکر استراتژیک است.

به عنوان یک متخصص سئو که هر روز با این نوسانات درگیرم، میدانم که این فرآیند چقدر میتواند پیچیده باشد. اما این مقاله جامع، نقشه راه شماست؛ از شناسایی ریشههای مشکلات کیفی محتوا (پاندا و Helpful Content) گرفته تا درک سیستمهای مدرن هوش مصنوعی (مانند BERT و MUM) که زبان انسان را میفهمند.

اگر میخواهید بدانید چگونه اصول فنی (Core Web Vitals) را به یک برگ برنده تبدیل کنید و در نهایت، چطور سایت خود را از یک ضربه الگوریتمی نجات دهید، ادامه مقاله را از دست ندهید تا بازی الگوریتمها را از یک "بازی حدس و گمان" به یک "استراتژی مطمئن" تبدیل کنیم.

به زبان ساده، الگوریتمهای گوگل مجموعهای فوقالعاده پیچیده از قوانین، فرمولها و مدلهای یادگیری ماشین (مانند هوش مصنوعی) هستند که وظیفه اصلیشان پاسخ دادن به دو سوال حیاتی است:

قصد کاربر چیست؟ (User Intent) کاربر واقعاً با این کلمه کلیدی دنبال چه چیزی میگردد؟

کدام سند/صفحه، بهترین پاسخ را دارد؟ کدام محتوا شایستهتر است که رتبه اول را کسب کند؟

الگوریتمها در کسری از ثانیه، صدها فاکتور (مانند سرعت سایت، کیفیت محتوا، اعتبار لینکها و تجربه نویسنده) را وزندهی و بررسی میکنند تا بهترین رتبهبندی ممکن را در صفحه نتایج جستجو (SERP) به شما نمایش دهند.

اگر گوگل یک مسابقه بزرگ جهانی باشد، الگوریتمها داوران و قانونگذاران آن مسابقه هستند که دائماً در حال اصلاح قوانین برای اطمینان از عدالت و کیفیت نهایی هستند.

اگرچه تغییرات مداوم الگوریتمها میتواند برای متخصصان سئو خستهکننده به نظر برسد، اما هدف اصلی و ثابت گوگل در طول این سالها یک چیز بوده است:

ارائه بهترین، مرتبطترین، معتبرترین و مفیدترین نتایج جستجو به کاربر در کوتاهترین زمان ممکن.

گوگل یک کسبوکار است و اعتماد کاربر، ارزشمندترین دارایی آن. اگر کاربران نتایج ضعیفی دریافت کنند، به مرور از گوگل دلسرد شده و به سمت موتورهای جستجوی رقیب خواهند رفت.

دلایل کلیدی تغییرات مداوم عبارتند از:

۱. هوشمندی بالاتر در شناسایی کیفیت: الگوریتمها مدام یاد میگیرند تا محتوای باکیفیت و تخصصی را (مبتنی بر اصول E-E-A-T که شامل تجربه، تخصص، اعتبار و اعتماد است) بهتر از محتوای سطحی یا تولید شده صرفاً برای رباتها تشخیص دهند.

۲. مبارزه با هرزنامه (Spam) و فریب: سئوکاران کلاه سیاه دائماً در پی یافتن راهکارهایی برای دور زدن الگوریتم هستند (مانند خرید لینک، محتوای خودکار با هوش مصنوعی ضعیف، کیورد استافینگ). هر آپدیت جدید، یک دفاع هوشمندانهتر در برابر این تاکتیکها است.

۳. تطابق با تغییر نیازهای کاربران: نحوه جستجوی کاربران، تغییر میکند (مثلاً جستجوی صوتی، جستجوی موبایلی یا جستجوهای بسیار بلند و پیچیده). گوگل باید زیرساخت خود را برای درک این نیّتهای جدید تطبیق دهد.

درک تفاوت این دو نوع بهروزرسانی برای تحلیل صحیح نوسانات رتبه سایت شما حیاتی است.

این بهروزرسانیها، تغییرات گسترده و عمدهای در هسته و منطق اصلی سیستم رتبهبندی گوگل هستند.

هدف: بهبود کلی کیفیت نتایج جستجو در تمام بخشها. گوگل اغلب میگوید: "ما زیرساخت خود را بهروزرسانی کردهایم تا محتوای باکیفیتتر را بهتر درک کنیم."

تأثیر: تأثیرات گسترده و بزرگ در رتبهبندی هزاران سایت. اغلب سایتهایی که افت میکنند، ایراد فنی خاصی ندارند، بلکه محتوایشان در مقایسه با رقبا، کمارزشتر ارزیابی شده است.

دوره زمانی: معمولاً چند بار در سال (حدوداً هر ۳ تا ۶ ماه یکبار) رخ میدهند.

این بهروزرسانیها، تغییرات متمرکز و خاصی هستند که برای هدفگیری یک موضوع یا مشکل خاص طراحی شدهاند.

هدف: هدفگیری و جریمه کردن تکنیکهای خاص سئو کلاه سیاه یا محتوای بیکیفیت. مثلاً، پنگوئن برای مبارزه با لینکسازی اسپم، و Helpful Content برای مقابله با محتوای تولید شده صرفاً برای موتور جستجو طراحی شدهاند.

تأثیر: تأثیر مستقیم و هدفمند بر روی سایتهایی که قوانین مرتبط (مثل لینکسازی اسپم یا محتوای کمکیفیت) را نقض کردهاند.

دوره زمانی: نامنظم و زمانی که گوگل نیاز به حل یک مشکل خاص در اکوسیستم جستجو دارد، منتشر میشوند.

نکته کلیدی : اگر سایت شما در یک Core Update افت رتبه پیدا کرد، به این معنی نیست که جریمه شدهاید، بلکه به این معنی است که سیستم رتبهبندی گوگل هوشمندتر شده و متوجه شده است رقبای شما شایستهتر هستند. تمرکز شما باید بر روی افزایش کیفیت کلی E-E-A-T سایت باشد.

از دیدگاه یک متخصص سئو با رویکرد بلندمدت و اخلاقی، الگوریتمها دشمن نیستند، بلکه بهترین متحد ما در مسیر خلق محتوای فوقالعادهاند.

شاید در کوتاهمدت، این تغییرات باعث افت ترافیک یا نوسان شود، اما این نوسانات، در واقع سیگنالهایی حیاتی هستند:

اگر محتوای شما رتبه گرفت: الگوریتمها به شما میگویند: "راه را درست آمدهاید؛ این محتوا برای کاربر مفید است. ادامه دهید."

اگر محتوای شما افت کرد: الگوریتمها به شما میگویند: "کیفیت محتوای شما در مقایسه با استاندارد جدید بازار یا نیّت کاربر، کافی نیست. آن را عمیقتر، تخصصیتر و کاربردیتر کنید."

تولید محتوای «مفید برای انسان»: از تمرکز صرف بر کلمات کلیدی دست بردارید. محتوایی خلق کنید که مشکل واقعی کاربر را حل کند (Helpful Content Update).

تمرکز بر E-E-A-T: بهخصوص در حوزههای حساس (مانند سلامت و پول)، مطمئن شوید که نویسنده تجربه کافی دارد و منابع شما معتبر هستند.

بهینهسازی تجربه کاربر (UX): سایت شما باید سریع، ریسپانسیو و آسان برای استفاده باشد. اگر کاربر نتواند محتوای باکیفیت شما را به راحتی مصرف کند، گوگل ارزش کمتری برای آن قائل خواهد شد.

جمعبندی: من به عنوان یک متخصص سئو، میدانم که این نوسانات بخشی جداییناپذیر از کار ما هستند. اما با پیروی از اصول اثباتشده کیفیت، تجربه و اعتبار که گوگل بر آنها تأکید دارد، میتوانیم مطمئن باشیم که سایت ما در برابر هر بهروزرسانی هستهای، نه تنها مقاومت میکند، بلکه احتمالاً رشد نیز خواهد داشت.

اگرچه در سالهای اخیر توجه رسانهها به آپدیتهای هسته (Core Updates) و الگوریتمهای مبتنی بر هوش مصنوعی (مانند RankBrain) جلب شده است، اما نباید نقش حیاتی الگوریتمهای کلاسیکی را که زیربنای کیفیت جستجو را شکل دادند، فراموش کنیم. این الگوریتمها، که به دلیل نامگذاریهای حیوانی خود مشهورند، هنوز هم اصول اساسی و اولیه سئو را تعریف میکنند و اگر یکی از قوانین آنها را نقض کنید، سایت شما با مشکل مواجه خواهد شد.

الگوریتم پاندا که در سال ۲۰۱۱ معرفی شد، زلزلهای در دنیای سئو به وجود آورد. ماموریت پاندا بسیار صریح بود: شناسایی و جریمه کردن سایتهایی که محتوای باکیفیت پایین یا اسپم تولید میکنند. قبل از پاندا، ترفندهایی مانند پر کردن صفحه با کلمات کلیدی (Keyword Stuffing) به راحتی جواب میداد. پاندا این بازی را تغییر داد و گوگل را از یک سیستم متمرکز بر «لینک»، به سیستمی متمرکز بر «محتوای با ارزش» سوق داد.

پاندا با شاخصهای زیر به قضاوت درباره کیفیت محتوا میپردازد:

محتوای نازک (Thin Content): صفحاتی که حجم کمی دارند و ارزش افزودهای برای کاربر ایجاد نمیکنند.

محتوای تکراری یا کپی (Duplicate Content): صفحاتی که عیناً یا با تغییرات بسیار کم در چندین جای سایت یا وبسایتهای دیگر تکرار شدهاند.

نسبت تبلیغات به محتوا: سایتهایی که آنقدر پر از تبلیغات هستند که دسترسی به محتوای اصلی دشوار میشود (بهبود تجربه کاربری).

محتوای تولید شده با کیفیت پایین: محتوایی که اطلاعات غلط، بدون عمق یا از نظر گرامری ضعیف باشد و نشانگر عدم تخصص نویسنده باشد.

نکته : اگر امروز به مشکلات رتبهبندی برخوردید، اولین سوالی که باید از خود بپرسید این است: "آیا محتوای من به قدری منحصر به فرد و کامل است که شایسته رتبه بهتر از رقیبم باشد؟" در واقع، پاندا به شما میگوید که "کمیت مهم نیست، کیفیت مهم است."

پس از آنکه پاندا به کیفیت محتوا رسیدگی کرد، نوبت به پنگوئن رسید. این الگوریتم که در سال ۲۰۱۲ معرفی شد، ماموریت داشت که با لینکسازیهای اسپم و ساختگی مبارزه کند. هدف آن ارتقاء سایتهایی بود که به صورت طبیعی و ارگانیک، به دلیل کیفیت محتوایشان لینک دریافت میکردند، و جریمه کردن سایتهایی که به صورت دستکاریشده و پولی لینک میساختند.

پنگوئن و اصول سئو کلاه سفید، تفاوت فاحشی بین دو نوع لینکسازی قائل هستند:

لینکسازی کلاه سفید (White Hat): لینکهایی که به صورت طبیعی، از سایتهای معتبر و مرتبط به دست میآیند. هدف این لینکها، ارجاع دادن کاربر به یک منبع مفید است. این دقیقاً همان چیزی است که پنگوئن دوست دارد و اعتبار سایت شما را افزایش میدهد.

لینکسازی اسپم/کلاه سیاه (Black Hat): شامل خرید انبوه لینک، تبادل لینک غیرمرتبط، یا استفاده از شبکههای خصوصی وبلاگ (PBNs) است. هدف این لینکها، دستکاری الگوریتم است. پنگوئن این فعالیتها را شناسایی کرده و سایت را جریمه میکند.

مرغ مگسخوار، که در سال ۲۰۱۳ معرفی شد، یک الگوریتم جدید نبود، بلکه یک بازنویسی کامل در هسته موتور جستجو بود. وظیفه اصلی آن، درک معنای واقعی (Concept) یک عبارت جستجو به جای صرفاً تطبیق کلمات کلیدی بود. این الگوریتم، آغاز مسیر گوگل به سمت درک "قصد کاربر" (User Intent) بود که امروز با کمک هوش مصنوعی بسیار پیشرفتهتر شده است.

مثال کلیدی: اگر قبلاً جستجو میکردید: "چگونه پنکیک درست کنیم"، گوگل فقط به دنبال صفحات دارای این کلمات بود. با آمدن مرغ مگسخوار، اگر جستجو کنید: "طرز تهیه غذای صبحانه گرد و شیرین"*، گوگل میفهمد که منظور شما پنکیک است و بهترین دستورالعملها را به شما نشان میدهد.

این الگوریتم به ما میآموزد که به جای تکرار زیاد یک کلمه، باید خوشه موضوعی مرتبط و جامع را با کلمات کلیدی ثانویه و مترادف پوشش دهیم تا الگوریتم متوجه شود که ما در این موضوع اقتدار داریم.

کبوتر در سال ۲۰۱۴ معرفی شد و هدف آن نزدیکتر کردن نتایج جستجوی محلی به الگوریتمهای استاندارد وب بود.

تأثیر کبوتر:

افزایش ارتباط: این الگوریتم نتایج محلی را بر اساس فاکتورهای سنتی سئو (مانند اعتبار دامنه، لینکسازی، و کیفیت محتوا) رتبهبندی کرد.

تمرکز جغرافیایی: اهمیت فاصله کاربر از محل کسبوکار را در رتبهبندیهای محلی (مانند "بهترین رستوران نزدیک من") به شدت افزایش داد.

اگر مخاطب شما کسبوکارهای محلی هستند، کبوتر به شما میگوید که بدون یک پروفایل بهینهشده Google Business Profile و اعتبار محلی قوی (Local Citations)، شانسی برای نمایش در نتایج نقشهها و سئوی محلی نخواهید داشت.

پس از اینکه گوگل با الگوریتمهای کلاسیک (پاندا، پنگوئن) به ساماندهی کیفیت محتوا و لینکها پرداخت، مرحله بعدی، مهمترین و سختترین چالش بود: درک زبان انسان. ما هنگام جستجو، اغلب با کلمات مبهم، سؤالات طولانی و محاورهای جستجو میکنیم. اینجا بود که هوش مصنوعی و یادگیری ماشین (Machine Learning) وارد عمل شدند تا الگوریتمهای جستجو را برای همیشه متحول کنند.

رنک برین که در سال ۲۰۱۵ معرفی شد، یک نقطه عطف تاریخی بود. این الگوریتم، اولین سیستم مبتنی بر یادگیری ماشین بود که بخشی از الگوریتم اصلی جستجوی گوگل شد. رنک برین به عنوان یکی از سه فاکتور اصلی رتبهبندی (در کنار لینکها و محتوا) معرفی شد.

وظیفه رنک برین این است که کلمات و عبارات جستجوی مبهم یا جدید (که تا کنون دیده نشدهاند) را بگیرد و آنها را به مفاهیمی تبدیل کند که گوگل بتواند مرتبطترین نتایج را برایشان پیدا کند.

رنک برین به طور مستقیم بر روی رفتار کاربر در نتایج جستجو نظارت میکند تا بفهمد آیا پاسخ درستی ارائه شده است یا خیر. شاخصهای اصلی آن برای ارزیابی موفقیت عبارتند از:

نرخ کلیک (CTR): اگر عنوان و توضیحات شما جذاب باشد و کاربر در صفحه نتایج روی شما کلیک کند، این یک سیگنال مثبت است.

نرخ پرش (Bounce Rate): اگر کاربر روی سایت شما کلیک کند و بلافاصله به صفحه نتایج برگردد (Pogo-sticking)، این یک سیگنال قوی و منفی است که نشان میدهد سایت شما پاسخ مناسبی برای قصد کاربر نبوده است.

زمان ماندگاری (Dwell Time): هرچه کاربر زمان بیشتری را صرف خواندن محتوای شما کند، سیگنال قویتری به رنک برین ارسال میشود که محتوای شما مفید و ارزشمند است.

پیام : در عصری که رنک برین حکومت میکند، تمرکز صرف بر کلمات کلیدی کافی نیست. شما باید مطمئن شوید که محتوای شما به بهترین شکل ممکن قصد کاربر را برآورده میکند، چرا که رفتار کاربر، مستقیماً الگوریتم را تغذیه و رتبهبندی شما را تنظیم میکند.

الگوریتم BERT (Bidirectional Encoder Representations from Transformers) که در سال ۲۰۱۹ معرفی شد، یک جهش بزرگ در درک زبان طبیعی (NLP) توسط گوگل بود. در حالی که رنک برین یک سیستم یادگیری ماشینی برای کل جستجو بود، برت یک سیستم عصبی برای درک زبان بود.

اهمیت برت در کجاست؟ برت توانست:

درک حروف اضافه: برای اولین بار، گوگل توانست حروف اضافه (مانند "برای"، "به"، "بدون") و ترتیب کلمات را درک کند. این امر باعث شد تا جستجوهای طولانی و محاورهای مانند "مدارسی که دانشجو را از تهران به اصفهان میبرند" به جای جستجوهای کوتاه و خشک، به درستی درک شوند.

فهم زمینه (Context): برت به موتور جستجو این امکان را داد که معنای یک کلمه را با نگاه کردن به کلمات قبل و بعد از آن (به صورت "دو جهته") درک کند.

نتیجه برای سئو: با برت، دوران جملات نامفهوم و تکرار کلمات کلیدی به پایان رسید. برت به ما میگوید که باید با زبان طبیعی و روان بنویسیم و پاسخهای مستقیم و شفاف ارائه دهیم. اگر محتوای شما برای انسان قابل درک و جذاب باشد، برت نیز آن را درک کرده و رتبههای بهتری کسب خواهید کرد.

جدیدترین و پیشرفتهترین الگوریتم درک زبان گوگل، MUM (Multitask Unified Model) است که در سال ۲۰۲۱ معرفی شد. مام نه تنها از برت قویتر است، بلکه چند وجهی (Multimodal) است.

مام دو قابلیت انقلابی دارد:

پردازش اطلاعات در چندین زبان: مام میتواند دانش را از محتوای موجود در بیش از ۷۵ زبان جمعآوری کند تا پاسخهایی با کیفیت بالا ارائه دهد، حتی اگر محتوای مرجع به زبان جستجو نباشد.

پاسخ به سؤالات چندوجهی و پیچیده: مام میتواند در یک جستجو، هم متن و هم تصاویر (و در آینده ویدیو و صوت) را درک کند و به سؤالاتی که نیاز به چندین مرحله یا جستجوی همزمان دارند، پاسخ دهد.

مثال قدرت MUM: به جای اینکه کاربر چندین جستجوی پشت سر هم انجام دهد (مثلاً: "بهترین کفش کوهنوردی برای پیادهروی در آلپ چیه؟" سپس "چگونه بلیط هواپیما به آلپ بگیرم؟" و در نهایت "در آلپ کجا اقامت کنم؟"). با استفاده از مام، گوگل میتواند با یک جستجوی پیچیده، یک مسیر کامل از محتوای مختلف را به کاربر ارائه دهد.

چشمانداز : مام به ما هشدار میدهد که سئو در حال حرکت از صفحات تککلمهای به سمت خوشههای موضوعی بسیار جامع و پوشش کامل سفر کاربر است. برای موفقیت، باید محتوایی تولید کنیم که نه تنها به یک سؤال، بلکه به تمام سؤالات بعدی کاربر در آن سفر نیز پاسخ دهد.

در سالهای اخیر، گوگل به طور فزایندهای از محتوای عالی صرف فاصله گرفته و به سمت یک اصل جدید حرکت کرده است: تجربه عالی محتوا. این به این معناست که حتی بهترین محتوای دنیا نیز اگر در یک وبسایت کند، ناامن یا غیر قابل دسترس در موبایل بارگذاری شود، شایستگی رتبههای بالا را ندارد. الگوریتمهای زیر، نشانگر این رویکرد جدید گوگل هستند.

Page Experience (تجربه صفحه) مجموعهای از سیگنالها است که گوگل برای ارزیابی تجربه کاربر از تعامل با یک صفحه وب اندازهگیری میکند. مهمترین بخش این سیگنال، هسته حیاتی وب (Core Web Vitals - CWVs) است که در سال ۲۰۲۱ به یک فاکتور رتبهبندی رسمی تبدیل شد.

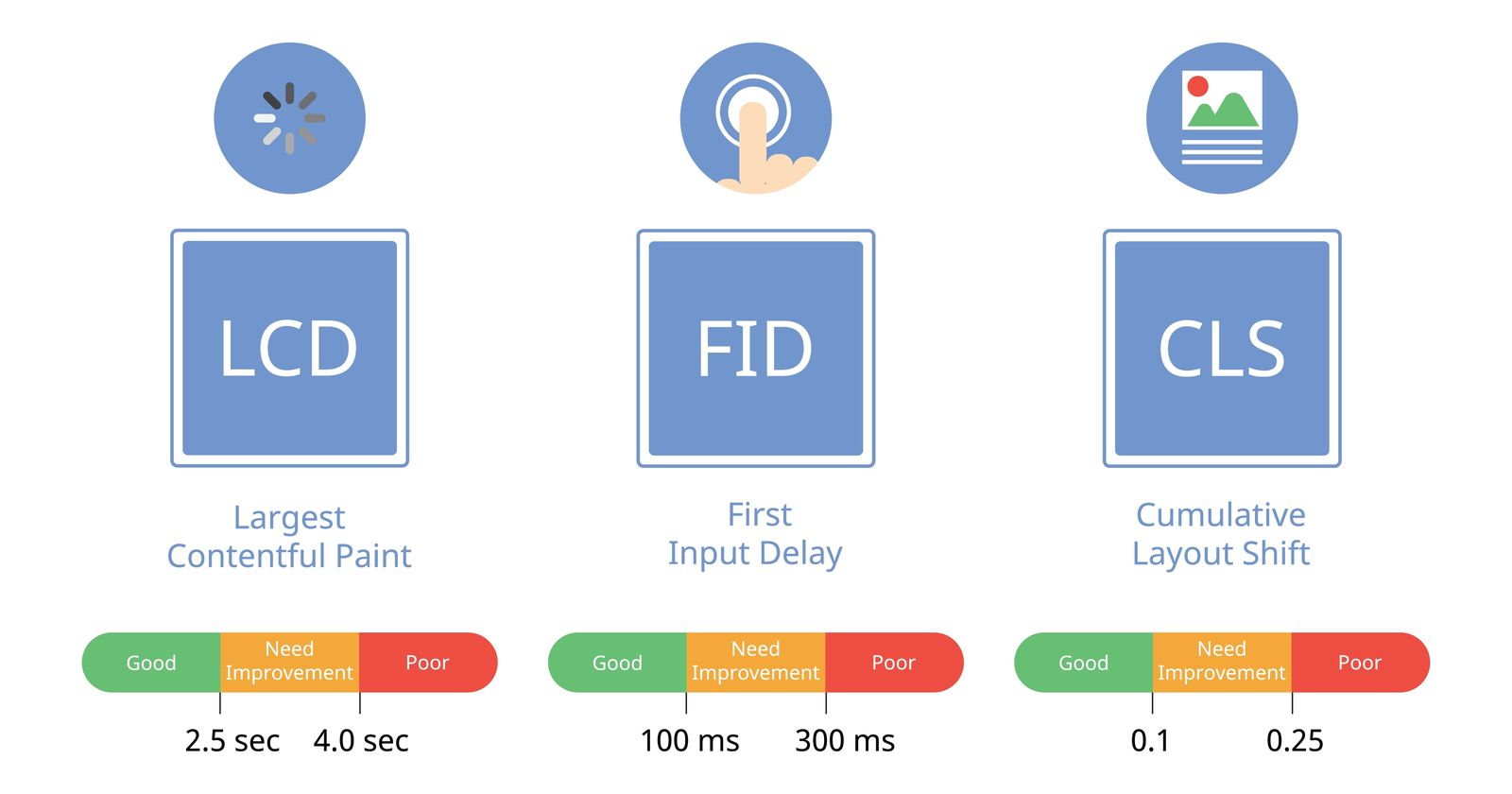

Core Web Vitals سه شاخص عملکردی، مشخص و قابل اندازهگیری هستند که گوگل آنها را معیارهای اصلی تجربه کاربری میداند:

LCP (Largest Contentful Paint): سرعت بارگذاری. مدت زمانی که طول میکشد تا بزرگترین عنصر محتوایی (مانند یک تصویر بزرگ یا بلوک متن اصلی) روی صفحه نمایش داده شود. (باید کمتر از ۲.۵ ثانیه باشد.)

FID (First Input Delay) / INP (Interaction to Next Paint): تعامل و پاسخگویی. مدت زمانی که طول میکشد تا صفحه به اولین تعامل کاربر (مانند کلیک روی یک دکمه) پاسخ دهد. INP معیار جدیدتر و دقیقتری برای سنجش تاخیر کلی تعاملات است و نشان میدهد که سایت چقدر سریع پس از تعامل کاربر، نمای بصری خود را بهروزرسانی میکند. (برای FID زیر ۱۰۰ میلیثانیه و برای INP زیر ۲۰۰ میلیثانیه ایدهآل است.)

CLS (Cumulative Layout Shift): ثبات بصری. سنجش میزان جابهجایی عناصر بصری غیرمنتظره در حین بارگذاری صفحه. (باید کمتر از ۰.۱ باشد.)

تحلیل : Core Web Vitals یک سیگنال حداقلی برای رتبهبندی است، نه یک عامل تمایز. یعنی سایتهایی که نمرات CWV خوبی کسب نمیکنند، شانس رقابت با محتوای مشابه اما سریعتر را از دست میدهند. تمرکز بر این معیارها یک اقدام Conversion & Action ضروری برای هر وبسایتی است.

پیش از سال ۲۰۱۸، گوگل ابتدا نسخه دسکتاپ وبسایت شما را خزش (Crawl) و ایندکس میکرد. اما با توجه به اینکه اکثریت کاربران از موبایل برای جستجو استفاده میکنند، الگوریتم Mobile-First Indexing معرفی شد.

اهمیت این الگوریتم:

اولویتبندی نسخه موبایل: گوگل اکنون محتوای نسخه موبایل سایت شما را به عنوان نسخه اصلی برای خزش، ایندکسگذاری و ارزیابی رتبهبندی استفاده میکند.

برابری محتوا: اگر محتوای مهمی در نسخه دسکتاپ داشته باشید که در نسخه موبایل (به دلیل پنهان شدن یا حذف) وجود نداشته باشد، آن محتوا هرگز ایندکس نخواهد شد و شما شانس رتبهبندی را از دست میدهید.

طراحی ریسپانسیو: این الگوریتم، توسعهدهندگان وب را وادار میکند تا به طور جدی از طراحیهای ریسپانسیو (Responsive Design) استفاده کنند که در هر اندازهای از صفحه، تجربه کاربری مناسبی ارائه دهند.

الگوریتم HTTPS از سال ۲۰۱۴ معرفی شد و گوگل رسماً اعلام کرد که استفاده از پروتکل امن HTTPS به جای HTTP یک فاکتور رتبهبندی کوچک است.

چرا امنیت برای سئو مهم است؟

اعتماد (Trust): HTTPS رمزگذاری دادهها بین مرورگر کاربر و سرور وبسایت شما را تضمین میکند. این امر بهویژه برای سایتهایی که اطلاعات حساس (مانند پرداخت یا ورود به حساب کاربری) را مدیریت میکنند، بسیار حیاتی است و مستقیماً با ستون اعتماد (Trust) در E-E-A-T مرتبط است.

تجربه مرورگر: مرورگرهای مدرن (مانند کروم و فایرفاکس) سایتهای HTTP را به عنوان "ناامن" علامتگذاری میکنند. این برچسبگذاری، اعتماد کاربر را تخریب کرده و میتواند منجر به نرخ پرش (Bounce Rate) بالاتر شود.

ضرورت برای ویژگیهای جدید: بسیاری از ویژگیهای پیشرفته وب (مانونده PWA یا Service Workers) تنها در محیطهای امن HTTPS در دسترس هستند.

اقدام سریع: اگر سایت شما هنوز از HTTPS استفاده نمیکند، باید فوراً این انتقال را انجام دهید. این یک فاکتور رتبهبندی نیست که بتوان از آن چشمپوشی کرد؛ بلکه یک پیشنیاز امنیتی برای حضور جدی و طولانیمدت در جستجوی گوگل است.

امروزه، سئو دیگر فقط درباره "کلمات کلیدی" نیست. سیستمهای جدید گوگل بر روی کیفیت کلی سایت، نیت نهایی کاربر و اعتبار واقعی نویسنده تمرکز دارند. این سیستمها از هوش مصنوعی بسیار پیچیدهای استفاده میکنند که نهتنها محتوای شما را میخواند، بلکه آن را بر اساس سیگنالهایی از دنیای واقعی قضاوت میکند. درک این اصول، نقشه راه شما برای تبدیل شدن به یک مرجع تخصصی (Topical Authority) است.

سیستم محتوای مفید (HCS) که از اواخر ۲۰۲۲ معرفی شد، شاید مهمترین تغییر در رویکرد گوگل در سالهای اخیر باشد. هدف این سیستم بسیار واضح است: جریمه کردن محتوایی که صرفاً برای رتبهگیری در گوگل تولید شده، نه برای کمک واقعی به انسان.

این سیستم به طور مداوم محتوای یک سایت را ارزیابی میکند و اگر بخش عمدهای از محتوای آن برای رباتها و نه انسانها نوشته شده باشد، کل سایت را تحت تأثیر قرار میدهد.

نشانههایی که HCS به دنبال آنهاست:

آیا محتوای شما پس از یک ساعت تحقیق مجدد، چیزی فراتر از آنچه در ۱۰ سایت اول است ارائه میدهد؟

آیا محتوای شما به خوبی به سوالات احتمالی کاربر پاسخ میدهد یا صرفاً به شکل سطحی کلمات کلیدی را تکرار کرده است؟

آیا نویسنده این محتوا، تجربه واقعی در مورد آنچه مینویسد دارد؟ (ارتباط مستقیم با E-E-A-T)

قانون طلایی : در دنیای HCS، هرگز محتوایی ننویسید که اگر موتور جستجویی در کار نبود، باز هم نمینوشتید. ارزش، ارزش، و باز هم ارزش واقعی برای خواننده، کلید اصلی است.

E-E-A-T (که مخفف Experience, Expertise, Authoritativeness, and Trustworthiness است)، اگرچه یک الگوریتم مجزا نیست، اما یک مجموعه اصول راهنما است که هسته تمام بهروزرسانیهای اصلی گوگل را تشکیل میدهد. اهمیت آن بهویژه در حوزههای YMYL (Your Money or Your Life) مانند سلامت و امور مالی، حیاتی است.

در نسخه جدید، Experience (تجربه) به این مجموعه اضافه شد تا گوگل اطمینان یابد نویسنده واقعاً از محصول یا سرویسی که درباره آن مینویسد، استفاده کرده و دانش او صرفاً تئوری نیست.

چگونه E-E-A-T را به یک استراتژی سئو تبدیل کنیم؟

Experience (تجربه): داستانهای موردی، بررسیهای دست اول، و مثالهای شخصی از اجرای استراتژیها را در محتوا بیاورید.

Expertise (تخصص): محتوا باید توسط افراد دارای مدارک یا سوابق حرفهای در آن حوزه نوشته یا بررسی شود.

Authoritativeness (اعتبار): سایت خود را به یک مرجع موضوعی (Topic Cluster) تبدیل کنید. لینک از سایتهای معتبر دیگر در حوزه خود دریافت کنید.

Trustworthiness (اعتماد): حتماً اطلاعات تماس، سیاستهای حفظ حریم خصوصی، و صفحات «درباره ما» را شفاف و کامل بنویسید تا کاربر و گوگل به هویت شما اعتماد کنند.

SpamBrain یک سیستم هوش مصنوعی و یادگیری ماشینی است که گوگل از آن برای محافظت از نتایج جستجو در برابر اسپم استفاده میکند. در حالی که الگوریتمهای قدیمی مانند پنگوئن پس از وقوع اسپم عمل میکردند، SpamBrain به صورت فعال و پیشگیرانه عمل میکند.

عملکرد کلیدی SpamBrain:

شناسایی اسپم در زمان واقعی: این سیستم قادر است سایتهای اسپم را در لحظه کشف و جریمه کند، نه اینکه منتظر آپدیت دورهای بماند.

لینکهای سمی (Toxic Links): SpamBrain در شناسایی سایتهایی که به صورت ساختگی و با هدف دستکاری رتبهبندی، لینکهای سمی میخرند یا میفروشند، بسیار قدرتمند است.

تشخیص اسپم خودکار: با پیشرفت هوش مصنوعیهای مولد، SpamBrain برای شناسایی حجم عظیمی از محتوای تولید شده توسط هوش مصنوعی که فاقد کیفیت E-E-A-T است، آموزش دیده است.

نکته تخصصی: امروزه، اعتماد کردن به لینکسازیهای مشکوک یک ریسک بزرگ است. SpamBrain این پیام را میدهد که هرگونه تلاشی برای فریب سیستم رتبهبندی، در نهایت توسط هوش مصنوعی خود گوگل شناسایی و با جریمه مواجه خواهد شد.

تجربه تولید جستجو (Search Generative Experience - SGE) که توسط گوگل معرفی شده، یک نمای پیشرو از آینده جستجو است. SGE مستقیماً از هوش مصنوعی مولد (مانند مدلهای بزرگ زبانی) استفاده میکند تا به جای نمایش لیستهای ۱۰ تایی لینک، یک پاسخ جامع، خلاصهشده و تعاملی در بالای صفحه جستجو (SERP) تولید کند.

تاثیر SGE بر استراتژی سئو:

کاهش کلیک بر روی نتایج سنتی: برای بسیاری از جستجوهای اطلاعاتی و ساده، کاربران پاسخ خود را مستقیماً از SGE دریافت خواهند کرد و دیگر نیازی به کلیک بر روی لینکها نخواهند داشت.

اهمیت Refe-E-A-Tence (مرجعیت و اعتبار): SGE پاسخ خود را از منابع موجود در وب تولید میکند و آن منابع را با لینک ارجاع میدهد. این امر به این معنی است که سایتهای شما باید آنقدر معتبر و تخصصی باشند که هوش مصنوعی گوگل آنها را به عنوان منبع اصلی پاسخهای خود انتخاب کند.

فرصت برای محتوای تخصصی: SGE در پاسخ به سؤالات عمیق، تحلیلی یا نظرات تخصصی ضعیفتر عمل میکند. این یک فرصت برای شماست تا با خلق محتوای کاملاً تخصصی و مبتنی بر تجربه (E-E-A-T)، جایگاه خود را به عنوان یک مرجع حفظ کنید.

در کنار غولهای سئویی مانند پاندا، پنگوئن و سیستمهای هوش مصنوعی (BERT و MUM)، گوگل مجموعهای از الگوریتمهای اختصاصی را نیز دارد که بر روی بخشهای بسیار خاصی از کیفیت محتوا و رفتار کاربر تمرکز میکنند. درک این الگوریتمهای کوچک اما حیاتی، میتواند در موارد خاص، برگ برنده شما در رتبهبندی باشد.

الگوریتم Pirate که در سالهای ۲۰۱۲ و ۲۰۱۴ معرفی شد، یک الگوریتم اختصاصی برای مبارزه با نقض حق تکثیر (Copyright Infringement) است.

ماموریت اصلی دزد دریایی:

این الگوریتم مستقیماً برای جریمه کردن سایتهایی طراحی شده که از طریق شکایتهای ثبتشده طبق قانون DMCA (Digital Millennium Copyright Act) و گزارشهای ارسالی به گوگل، محتوای دارای حق کپیرایت را به صورت غیرقانونی منتشر میکنند (مانند دانلود غیرمجاز فیلمها، موسیقی، کتابهای الکترونیکی و نرمافزارها).

تأثیر بر سئوی عمومی:

اگرچه دزد دریایی مستقیماً به محتوای بلاگ شما کاری ندارد، اما این الگوریتم یک پیام واضح از گوگل میدهد: احترام به مالکیت فکری، بخشی از اعتماد (Trust) است. اگر سایت شما به طور مداوم محتوای دیگران را بدون اجازه منتشر کند، اعتبار و اقتدار شما نزد گوگل کاهش یافته و ممکن است تحت جریمههای گستردهتری نیز قرار بگیرید.

الگوریتم Freshness در سال ۲۰۱۱ معرفی شد و به گوگل کمک میکند تا درک کند که برای چه نوع جستجوهایی، زمان و بهروز بودن محتوا یک فاکتور حیاتی است. این الگوریتم برای برخی از جستجوها، به محتوای جدید، رتبه بالاتری میدهد.

زمان، فاکتوری حیاتی است برای:

اخبار و رویدادهای جاری: مانند نتایج بازی دیشب یا آخرین قیمت طلا.

موضوعات داغ یا پرطرفدار: موضوعاتی که به طور ناگهانی و کوتاه مدت ترند میشوند.

بهترینها و بررسیها: محتواهایی که در یک حوزه خاص نیاز به بهروزرسانی مداوم دارند، مانند بهترین تلفنهای همراه در سال ۲۰۲۵ یا بهترین استراتژیهای لینکسازی پس از آپدیت هسته اخیر.

استراتژی : این الگوریتم به ما میگوید که تاریخ انتشار و تاریخ آخرین بهروزرسانی بسیار مهم هستند. برای کلمات کلیدی که نیاز به تازگی دارند، باید به طور دورهای محتوای خود را بازنویسی، بهروزرسانی و دوباره منتشر کنید (Content Refreshing) تا این سیگنال را به گوگل بفرستید که اطلاعات شما همچنان مرتبط و معتبر هستند.

اگرچه گوگل هرگز به طور رسمی آن را "الگوریتم مدیک" نام نبرده، اما این نام توسط جامعه سئو به بهروزرسانی گستردهای در سال ۲۰۱۸ داده شد که تأثیر عظیمی بر سایتهای حوزههای YMYL (Your Money or Your Life) گذاشت.

YMYL شامل حوزههایی است که اگر اطلاعات غلطی در آنها ارائه شود، میتواند بر سلامت، رفاه مالی یا امنیت کاربر تأثیر بگذارد:

سایتهای سلامت و پزشکی.

سایتهای مالی، سرمایهگذاری و اعتباری.

سایتهای حقوقی و دولتی.

تمرکز الگوریتم مدیک (و Core Updateهای پس از آن):

مدیک بر اهمیت E-E-A-T (بهخصوص تخصص، اعتبار و اعتماد) در این حوزهها تأکید مضاعف داشت. سایتهایی که افت رتبه داشتند، غالباً فاقد یکی از موارد زیر بودند:

تخصص نویسنده: محتوای پزشکی که توسط فردی بدون مدرک پزشکی نوشته شده باشد.

اعتبار سایت: فقدان صفحات «درباره ما» شفاف، منابع معتبر یا نظارت متخصص.

اعتماد کاربر: نبود سیاستهای واضح، امنیت ضعیف (HTTPS) و محتوای گمراهکننده.

درس نهایی: اگر در یک حوزه YMYL فعالیت میکنید، E-E-A-T برای شما صرفاً یک فاکتور نیست، بلکه یک پیششرط اساسی برای رقابت است. گوگل در این حوزهها، هیچ خطایی را تحمل نمیکند.

وقتی در ترافیک یا رتبهبندی سایت خود افت ناگهانی مشاهده میکنید، اولین سوال این است: "آیا من توسط یک الگوریتم گوگل جریمه شدهام؟" این مرحله، مرحله حیاتی تشخیص است که باید با دقت و بدون استرس انجام شود. اغلب اوقات، افت رتبه جریمه نیست، بلکه یک تغییر در رتبهبندی (Ranking Shift) به دلیل ارتقاء رقبای شماست.

دو نوع جریمه اصلی وجود دارد:

جریمه دستی (Manual Action): توسط یک کارمند گوگل، به دلیل تخطی آشکار از دستورالعملها (مانند اسپمهای واضح) اعمال میشود. این جریمه به وضوح در Google Search Console قابل مشاهده و شناسایی است.

جریمه الگوریتمی (Algorithmic Penalty): این جریمهها (یا بهتر است بگوییم فیلترهای الگوریتمی) به طور خودکار توسط سیستمهایی مانند پاندا یا پنگوئن اعمال میشوند و هیچ پیامی در کنسول جستجو ندارند. تشخیص آن نیاز به تحلیل دقیق دادهها دارد.

تشخیص اینکه افت ترافیک شما به یک آپدیت خاص مرتبط است یا خیر، به استفاده از ابزارهای زیر نیاز دارد:

Google Search Console (GSC):

کجا را ببینیم؟ بخش Manual actions و گزارش Performance.

نقش کلیدی: GSC تنها ابزاری است که میتواند جریمههای دستی را به شما اطلاع دهد. همچنین، با بررسی نمودار ترافیک در گزارش عملکرد، میتوانید زمان دقیق افت ترافیک را پیدا کنید.

ابزارهای ردیابی آپدیت (مانند SEMrush Sensor یا MozCast):

نقش کلیدی: این ابزارها "نوسان" روزانه در نتایج جستجو (SERP Volatility) را در سطح جهانی ردیابی میکنند. اگر افت ترافیک شما دقیقاً مصادف با یک نوسان بالا یا یک تاریخ تأیید شده آپدیت هسته گوگل باشد، احتمالاً الگوریتم مقصر است.

ابزارهای تحلیلی (مانند Google Analytics یا Looker Studio):

نقش کلیدی: تحلیل ترافیک ارگانیک به صورت روزانه و بررسی اینکه آیا افت رتبه شما در سطح کل سایت است (نشانگر آپدیت هسته یا جریمه بزرگ) یا فقط در چند صفحه خاص (نشانگر یک مشکل کیفی در آن صفحات) رخ داده است.

نکته تخصصی : اگر جریمه دستی در GSC مشاهده نکردید، احتمالاً مشکل شما جریمه نیست؛ بلکه محتوای شما دیگر برای رتبهگیری، به اندازه کافی خوب نیست (در مقایسه با استانداردهای جدید E-E-A-T یا Helpful Content).

بازگرداندن رتبه سایت پس از یک ضربه الگوریتمی (بهویژه آپدیت هسته) نیاز به صبر، تحلیل دقیق و اقدامات گسترده دارد. این یک کار یکشبه نیست.

بررسی جریمه دستی: اول از همه، Google Search Console را چک کنید. اگر جریمه دستی وجود داشت، باید فوراً مشکل را برطرف کرده و درخواست بازنگری (Reconsideration Request) ارسال کنید.

تعیین نوع آپدیت: افت رتبه شما با کدام آپدیت همزمان شده است؟ اگر با پاندا (کیفیت محتوا) مرتبط است، روی محتوا تمرکز کنید. اگر با پنگوئن (لینک) مرتبط است، روی لینکهای سمی کار کنید.

شناسایی صفحات آسیبدیده: کدام صفحات بیشترین افت ترافیک را داشتهاند؟ این صفحات باید اولویت کاری شما باشند.

اگر مشکل از کیفیت محتوا بود (پاندا یا Helpful Content):

بهبود E-E-A-T: اطمینان حاصل کنید که نویسنده محتوا متخصص است (بیوگرافی نویسنده را تقویت کنید) و منابع معتبر در محتوا ذکر شدهاند.

حذف یا ترکیب محتوای نازک: صفحات کمکیفیت و بدون تخصص را یا بهبود اساسی دهید، یا با صفحات دیگر ترکیب کنید و یا با استفاده از تگ noindex یا کد وضعیت 410 آنها را از ایندکس گوگل خارج سازید.

عمقبخشی: محتوا را چنان جامع کنید که نه تنها به سؤال اصلی، بلکه به تمام سؤالات بعدی کاربر (بر اساس الگوریتم MUM) پاسخ دهد.

اگر مشکل از لینکهای اسپم بود (پنگوئن و SpamBrain):

ممیزی لینک: تمام بکلینکهای ورودی خود را بررسی کنید و لینکهایی که از سایتهای اسپم، غیرمرتبط یا با متن لنگر (Anchor Text) تکراری و مشکوک میآیند را شناسایی کنید.

استفاده از Disavow Tool: از ابزار Disavow گوگل در GSC برای اعلام بیارتباطی به این لینکهای سمی استفاده کنید تا گوگل آنها را نادیده بگیرد.

بهبود Core Web Vitals: با بهبود سرعت، تعامل و ثبات بصری سایت (LCP, INP, CLS) سیگنالهای مثبت تجربه کاربر را به گوگل ارسال کنید.

ترویج فعال: صرفاً منتظر نباشید. محتوای بهروز شده و باکیفیت خود را در شبکههای اجتماعی، ایمیل و سایر کانالهای معتبر ترویج دهید تا ترافیک و تعامل مثبت را به سمت سایت خود هدایت کنید.

صبر کنید: پس از انجام اصلاحات، باید منتظر آپدیت هسته بعدی گوگل بمانید. الگوریتمها معمولاً به صورت مداوم (Real-Time) پس از اعمال تغییرات بهبودی نشان نمیدهند و سایت شما برای بازگشت نیاز به یک "تازه سازی" کامل در زمان بهروزرسانی بعدی هسته دارد.

اگر تا اینجای مقاله با ما همراه بودهاید، تبریک میگویم! شما اکنون فراتر از یک سئوکار مبتدی فکر میکنید. شما به خوبی میدانید که سئو مجموعهای از ترفندهای لحظهای برای گول زدن گوگل نیست، بلکه یک استراتژی بلندمدت و مبتنی بر کیفیت و اعتماد است.

ما دیدیم که الگوریتمهای گوگل، از پاندا و پنگوئن در عصر کلاسیک گرفته تا RankBrain، BERT و MUM در عصر هوش مصنوعی، همگی یک هدف مشترک دارند: ارائه بهترین تجربه ممکن به کاربر.

نکته کلیدی که باید از این مقاله با خود ببرید:

برای پیروزی در سئو، باید E-E-A-T را در هسته کسبوکار خود قرار دهید. اگر تخصص، تجربه، و اعتبار شما در دنیای واقعی قابل لمس باشد، الگوریتمهای گوگل دیر یا زود آن را تشخیص خواهند داد و شما را به عنوان مرجع نهایی آن حوزه معرفی خواهند کرد. بهروزرسانیهای هسته (Core Updates) برای سایتهای بیکیفیت یک تهدید هستند، اما برای کسانی که با بالاترین کیفیت کار میکنند، یک فرصت عالی برای سبقت گرفتن از رقبا.

✅ فراخوان نهایی: گام بعدی در مسیر استادی سئو چیست؟

همراهان عزیز، دنیای الگوریتمها هر روز در حال تغییر است و این سفر آموزشی هیچگاه متوقف نمیشود. من، حسین، بهعنوان یک متخصص سئو که همیشه در حال یادگیری و بهروزرسانی هستم، دوست دارم تجربیات عملی و نکات لحظهای این مسیر پر فراز و نشیب را مستقیماً با شما به اشتراک بگذارم.

اگر به دنبال تحلیلهای دست اول از آپدیتهای گوگل، استراتژیهای عملی دیجیتال مارکتینگ و سئو و گفتوگوهای تخصصی در این حوزه هستید، شما را دعوت میکنم تا به جمع همراهان ما در تلگرام بپیوندید.

برای ادامه مسیر یادگیری و قدم گذاشتن در مسیر سئوی حرفهای، روی لینک زیر کلیک کنید:

🔗 کانال تلگرام ما: [@hooseinmseo]

منتظرتان هستم تا با هم، پیچیدهترین مفاهیم سئو را به سادهترین استراتژیهای رشد تبدیل کنیم.