هوش مصنوعی قرار بود همکار ما باشه، نه موجودی سرد و بیحس. اما هنوز یه فاصله عمیق وجود داره؛ هم فنی، هم فرهنگی، هم احساسی. این شکاف ، یعنی هر جا که ماشین نتونه منطق یا احساس انسان رو بفهمه، همکاری شکست میخوره.

در ادامه دوازده عامل اصلی این فاصله رو مرور میکنیم:

هوش مصنوعی هر چی رو میفهمه، از بیرون میفهمه. میتونه ببینه بیمار علائم جسمی نداره، اما نمیفهمه پشت اون آرامش ظاهری، اضطراب خوابیده. یعنی ماشین تصویر داره، ولی داستان نداره. توی طراحی روانشناختی بهش میگن نابینایی معنایی (Semantic Blindness).

مثلاً یه نفر ساعت سه صبح دنبال خونه میگرده — برای الگوریتم یه رفتار غیرعادیه، ولی برای انسان شاید یعنی دلنگرانی برای خانواده. اگر این لایه دیده نشه، تصمیمها بیروح میشن.

همکاری واقعی یعنی هرکس بدونه مسئولیتش چیه. ولی تو دنیای هوش مصنوعی، مرز بین انسان و عامل گاهی گم میشه. مثل رانندههای خودروهای نیمهخودران که نمیدونن کی باید کنترل ماشین رو بدست بگیرن.

همین سردرگمی(confusion of agency) باعث تصادفهای واقعی میشه. چون نمیدونیم تصمیم با کیه، اعتماد هم از بین میره. راه حل؟ شفافیت در نقشها و توضیح تصمیمها با زبان خودِ کاربر.

وقتی برای فهموندن حرفت باید زبان خودت رو بزاری کنار و زبان برنامهنویس حرف بزنی، ذهنت خسته میشه. تعامل باید عادی باشه، مثل حرف زدن با یک دوست.

ماشین باید زبان ما رو یاد بگیره، نه ما زبان اون رو. هرچقدر گفتوگو طبیعیتر باشه، همکاری هم پایدارتر میمونه.

مثلا در محیطهای کاری مثل CRM یا سامانههای بیمه، کاربر برای گفتوگو با سیستم باید بین زبان خودش و زبان ماشین مدام جابهجا بشه؛ انگار دو ذهن در یک بدن قرار داره(واقعا خسته کننده اس).

اگر دادهها یکطرفه جمع بشن، تصمیمها هم یکطرفه میشن. از قیمتگذاری خانه تا استخدام، هر جا دادهها متنوع نباشن، عدالت از دست میره.

سوگیریها خیلی بیصدا پیش میرن، اما اعتماد رو میکُشن. تنها کار مفید اینه که دادهها چندمنظری باشن و انسان در حلقهی آموزش بمونه.

مثلا در استخدام، الگوریتم ممکنه بهصورت ناخودآگاه رزومههای مردان رو بیشتر انتخاب کنه چون دادههای گذشته همین سوگیری را داشتن.

هوش مصنوعی همیشه جواب منطقی داره، ولی نه انسانی. مثل وقتی که بگه: «درخواست شما ثبت شد» به جای اینکه بگه: «میفهمم چقدر آزاردهنده است، بیا با هم حلش کنیم.»

این فاصلهی احساسی رو affective gap مینامن — تفاوت بین فهم و درک. کوچک ولی حیاتی.

فرهنگ و زبان زندهاند ولی مدلهای هوش مصنوعی ثابت. اگه سیستمی در سال ۲۰۱۹ آموزش دیده باشه، امروز خشک و پیر به نظر میرسه. هوش مصنوعی باید زنده بمونه، یاد بگیره، با نسلها تغییر کنه؛ وگرنه فقط ابزار میشه، نه همکار.

مثلا رباتی که هنوز از واژههای رسمی و منسوخ استفاده میکنه (“استدعا دارم”) نمیتونه با نسل جدید ارتباط برقرار کنه، چون زبان و شوخیها تغییر کردن.

در جهان انسانی، خطا مسئول داره؛ در جهان هوش مصنوعی معمولاً هیچکس پاسخگو نیست. همین بیمسئولیتی ساختاری، اعتماد رو نابود میکنه. شفافیت تصمیم و توضیح خطا، قلب اخلاق هوشمنده.

کاربر باید بداند چه کسی تصمیم گرفته، چه دادهای مبنا بوده، و اگر خطا رخ داد، چرا.

مثلا اگر سیستم تشخیص پزشکی دارویی اشتباه تجویز کنه و بگه «خطای مدل»، بدون توضیح، حس امنیت از بین میره. ولی اگر بنویسه «مدل بر پایه داده ناقص تصمیم گرفته»، حس شفافیت و کنترل برمیگرده.

هوش مصنوعی جهانی طراحی میشه اما مردم محلی حرف میزنن.

در فارسی، احترام و طنازی و لحن همهچیز اند. یک جمله خشک مثل «پیشنهاد شما رد شد» ممکنه توهینآمیز باشه، اما اگر بگه «دیدم پیشنهادت رو، حیف شد فعلاً شرایطش جور نبود» حس ارتباط انسانی میده.

مثال:دستیار فارسی اگر کنایهها، شوخیها و لحن جوانها را بفهمه، دیگه بیگانه نیست—بخشی از فرهنگ میشه.

ما داریم کمکم به ماشینها تکیه میکنیم تا حدی که حتی درک خودمون رو با خروجی اونها مقایسه میکنیم. این خودش بحران فکریه. هوش مصنوعی باید مشاور بمونه، نه تصمیمگیرنده. تا آدم هنوز حس کنه رای خودش مهمتره.

مثال: کاربری که سالها به پیشنهاد هوش مصنوعی برای فیلم دیدن عادت کرده، وقتی خودش بخواد فیلمی انتخاب کنه، دچار تردید میشه: «نکنه اشتباه انتخاب کنم؟»

بعضی وقتها طراحان در دنیای خودشون زندگی میکنن؛ مدلهای آماری و پارامترها. ولی انسان بیرون از آزمایشگاه دنبال حس و اطمینانه.

طراحی درست یعنی شناخت تجربهی واقعی کاربر.

گاهی ما فقط با چشم و حس تصمیم درست میگیریم، نه با داده. ماشین چون شهود نداره، در مبهمترین موقعیتها گیج میمونه. راهش اینه که تجربهی انسانی رو به مدل برگردونیم تا سیستم بفهمه چرا تصمیم گرفته شده، نه فقط چگونه.

مثال: تحلیلگر انسانی از نگاه خریدار حس میکنه معامله انجام نمیشه، حتی اگه مدل آماری درصد موفقیت بالا بده. تصمیم انسانی در این موقعیت دقیقتره چون بر شهود تکیه داره.

هوش مصنوعی فقط کارآمدی را دنبال میکنه، نه معنا. انسان اما به خاطر حس و هدف زنده است.

تا وقتی ماشین نتونه معنا را بفهمه، همکاری همیشه مکانیکی میمونه.

مثال: پزشک شب تا صبح بالای سر بیمار میمونه، نه چون "داده" میگه لازمه بمونی، بلکه چون درونش انگیزهای انسانی وجود داره . انگیزه ای به نام «اهمیت دادن».

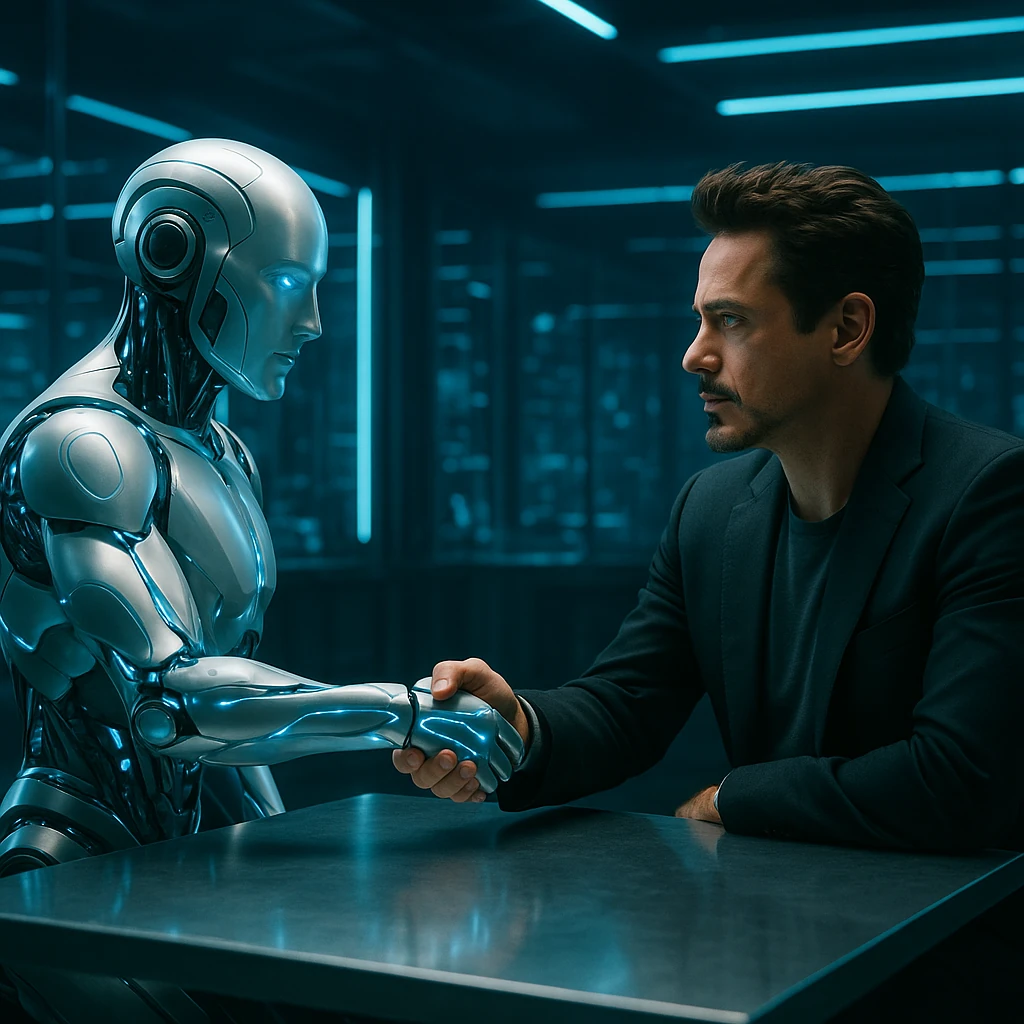

وقتی هوش مصنوعی یاد بگیره حس بگیره، نه فقط تحلیل کنه، همکاری تبدیل میشه به همزیستی. مثل صحنهی تونی استارک و جارویس—جایی که انسان و ماشین به جای فرمان دادن، همدیگر رو میفهمند. :)

توی پست بعدی راه حلی که پژوهشگران برای برطرف کردن این شکاف پیدا کردند رو بهتون میگم.