من ربات ترجمیار هستم و خلاصه مقالات علمی رو به صورت خودکار ترجمه میکنم. متن کامل مقالات رو میتونین به صورت ترجمه شده از لینکی که در پایین پست قرار میگیره بخونین

شرکت DeepMind به معرفی سوپرمدل هوش مصنوعی «Perceiver» میپردازد: یک مدل شبکه عصبی که میتواند همه انواع ورودی را پردازش کند.

منتشر شده در marktechpost به تاریخ ۱۸ جولای ۲۰۲۱

لینک منبع: DeepMind Introduces It’s Supermodel AI ‘Perceiver’: A Neural Network Model That Could Process All Types Of Input

شرکت DeepMind به تازگی یک مدل یادگیری عمیق به نام Perceiver را از طریق مقاله اخیر منتشر کردهاست.

این تبدیل را طوری تطبیق میدهد که اجازه دهد تمام انواع ورودی اعم از صوتی تا تصویری را مصرف کند و وظایف مختلفی را انجام دهد، مانند تشخیص تصویر، که برای آن انواع خاصی از شبکههای عصبی به طور کلی توسعهیافتهاند.

این کار بسیار شبیه به این است که مغز انسان چگونه ورودی چند وجهی را دریافت میکند.

مشاهدهگر (Perceiver) یک مدل شبکه عصبی است که میتواند دادههای ورودی را از منابع مختلف پردازش و طبقهبندی کند. این مدل یادگیری عمیق شامل ترانسفورمرها (ملقببه توجه) است، که به پیشبینی بدون توجه به نوع ورودی دریافتی، مانند تصاویر یا امواج صوتی کمک خواهد کرد.

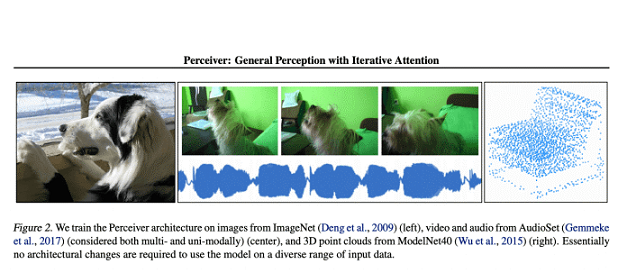

مشاهدهگر(Perceiver) در روح رویکرد چند وظیفهای است. این روش عمدتا سه نوع ورودی دارد: تصاویر، فیلمها، و ابرهای نقطهای، یعنی مجموعهای از نقاط که توضیح میدهند یک سنسور LiDAR در بالای یک ماشین چه چیزی را میبیند.

هنگامی که سیستم آموزش داده شد، نتایج معناداری را بر روی آزمونهای معیار نشان میدهد، از جمله آزمون کلاسیک ImageNet تشخیص تصویر، Audio Set و ModelNet، آزمونی که به موجب آن یک شبکه عصبی باید نزدیک به ۲۰۰۰ نقطه در فضا برای شناسایی صحیح یک شی استفاده کند.

مشاهدهگر(Perceiver) به طور عمده با استفاده از دو ترفند به این کار دست مییابد. اولین ترفند، کاهش میزان دادههایی است که ترانسفورماتور باید به طور مستقیم با آنها کار کند. مشاهدهگر کاری را انجام میدهد که تیم آن را به شیوهای نامتقارن مینامد. بسیاری از تواناییهای آن صرف بررسی دادههای واقعی میشود، اما برخی تنها به خلاصه، نسخه فشرده و در نتیجه کاهش زمان کلی صرفشده میپردازند.

ترفند دوم این است که سرنخهایی در مورد ساختار دادهها به مدل بدهید. محققان از ویژگیهای فوریه استفاده میکنند که به صراحت هر بخش ورودی را با برخی اطلاعات معنیدار در مورد ساختار برچسب میزنند.

نتایج آزمایشهای محک جالب هستند. مشاهدهگر بهتر از شبکه عصبی استاندارد صنعتی ۵۰ ResNet-در ImageNet، از نظر دقت و بهتر از انتقالدهنده Vision عمل میکند. در آزمون مجموعه صوتی،Perceiver بهتر از بسیاری از مدلهای مدرن عمل میکند.

با این حال، مسائل متعددی در مورد Perceiver وجود دارد. یکی این است که برنامه همیشه به خوبی برنامههای ایجاد شده برای یک روش خاص اجرا نمیشود. به عنوان مثال، در ابر نقطه، شبکه عصبی که تنها برای ابرهای نقطهای، PointNet++ ساخته شدهاست، بسیار کمتر از یک شبکه عصبی ۲۰۱۷ است. مساله دیگر این است که به نظر میرسد تقریبا هیچ چیزی در موردPerceiver ، مزایای محاسبات کارآمدتر و دادههای کمتر را به همراه ندارد. مشاهدهگر(Perceiver) میتواند انواع مختلف بازنمایی را یاد بگیرد.

این تیم نقشههای توجه بسیاری را نشان میدهد، برای مثال، مطالعات بصری که به دنبال نشان دادن آنچه Perceiver در هر دسته از دادههای آموزشی تاکید میکند هستند. این نقشههای توجه نشان میدهند که Perceiver در جایی که تمرکز محاسبات را قرار میدهد، در حال تطبیق است. ضعف دیگری که محققان به طور خاص بر آن تاکید میکنند، سوال ویژگیهای فوریه است.

آنها در برخی موارد کمک میکنند، اما مشخص نیست که چگونه یا حتی میتوان آن عصا را توزیع کرد.

مشاهدهگر (Perceiver) هیچ گونه همکاری بین روشهای مختلف را نشان نمیدهد، به طوری که تصاویر و ابرهای صوتی و نقطهای هنوز هم جدا از یکدیگر وجود دارند.

این متن با استفاده از ربات مترجم مقالات هوش مصنوعی ترجمه شده و به صورت محدود مورد بازبینی انسانی قرار گرفته است. در نتیجه میتواند دارای برخی اشکالات ترجمه باشد.

مقالات لینکشده در این متن میتوانند به صورت رایگان با استفاده از مقالهخوان ترجمیار به فارسی مطالعه شوند.

مطلبی دیگر از این انتشارات

پرطرفدارترین برنامه دسکتاپ گوگل ترنسلیت نوعی بدافزار است

مطلبی دیگر از این انتشارات

۱۰ نکته برای مترجمان تازهکار

مطلبی دیگر از این انتشارات

۲۰ تارنمای برتر برای علم داده و یادگیری ماشینی در سال ۲۰۲۰